はじめに:エージェント型AIは、なぜPoCで止まるのか

AI活用の次の段階として、エージェント型AI(Agentic AI)への関心が急速に高まっています。

AIが人を支援する存在から、業務を自律的に実行し、判断を下す存在へと進化することで、生産性と業務スピードを飛躍的に高められる可能性があるからです。

BCG(Boston Consulting Group)が発表したレポート

「To Unlock the Full Value of AI, Invest in Your People」

は、こうした期待の一方で、多くの企業がAIの価値を十分に引き出せていない現実を、第三者の視点から明確に示しています。

本記事ではこのレポートを踏まえ、日本企業がエージェント型AIを全社展開しようとした際に、ITリーダーが直面する本質的な課題を整理します。

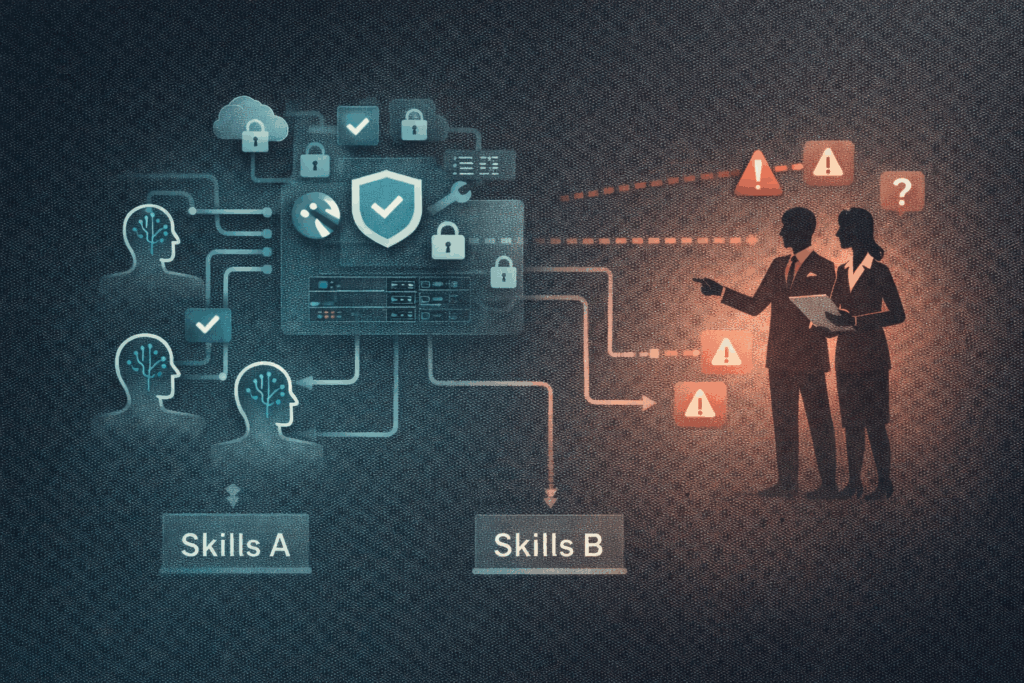

エージェント型AIが目指す業務変革の姿

エージェント型AIが描く世界観は、極めて明確です。

- AIが単に人を支援する存在ではなく

- 業務を自律的に実行し

- 判断を下し

- 人は例外対応と監督に集中する

このモデルが実現すれば、業務の再現性とスピードは大きく向上します。

しかし現実には、多くの企業でエージェント型AIの導入はPoC止まり、あるいは個人単位の効率化にとどまっています。

なぜ、全社展開に踏み切れないのでしょうか。

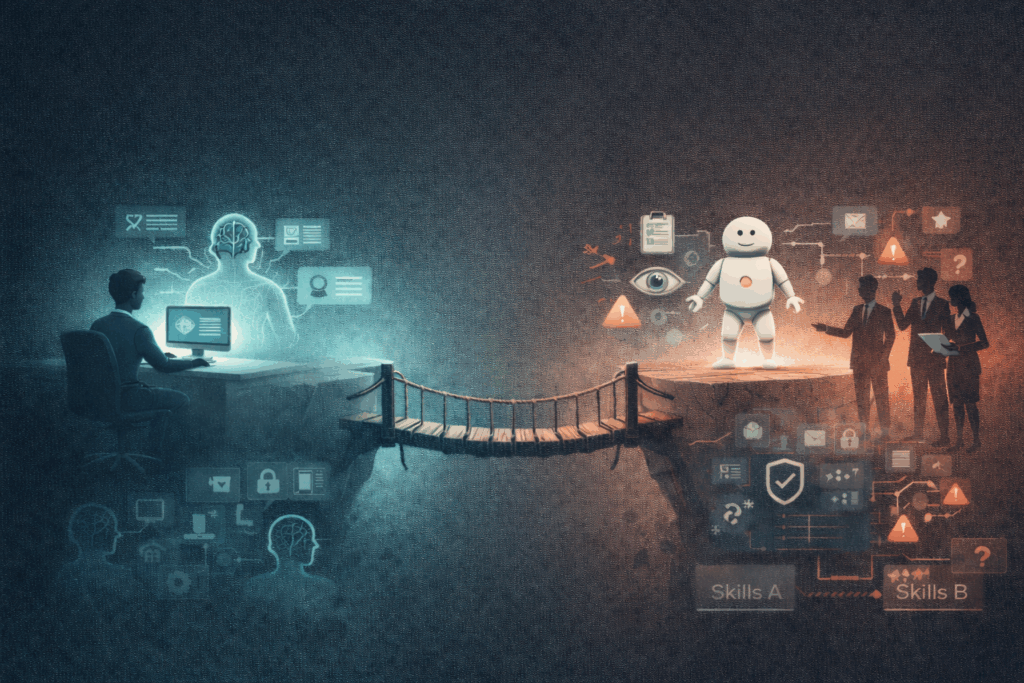

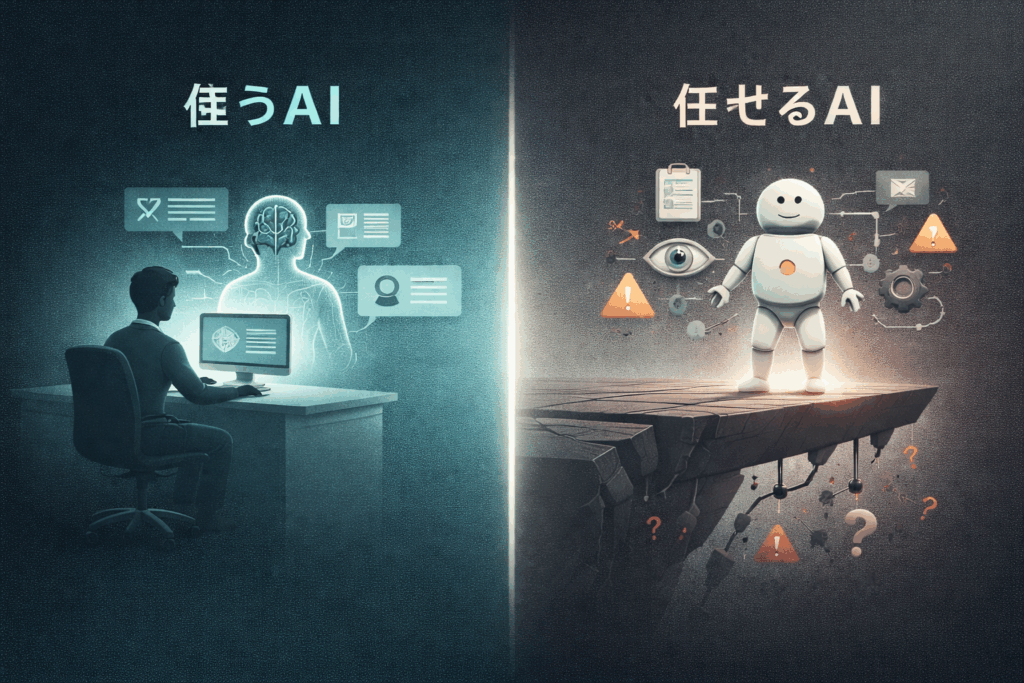

「使うAI」から「任せるAI」へ移行する際の壁

従来の生成AI活用では、人が主体的にプロンプトを入力し、結果を評価し、最終判断を下す前提がありました。

判断の主体は、常に人でした。

一方、エージェント型AIでは前提が根本的に変わります。

- AIに仕事を任せる

- AIの判断を前提に業務が進む

- 人はあえて「介入しない」という判断を行う

この瞬間、技術的な完成度とは別次元の課題が顕在化します。

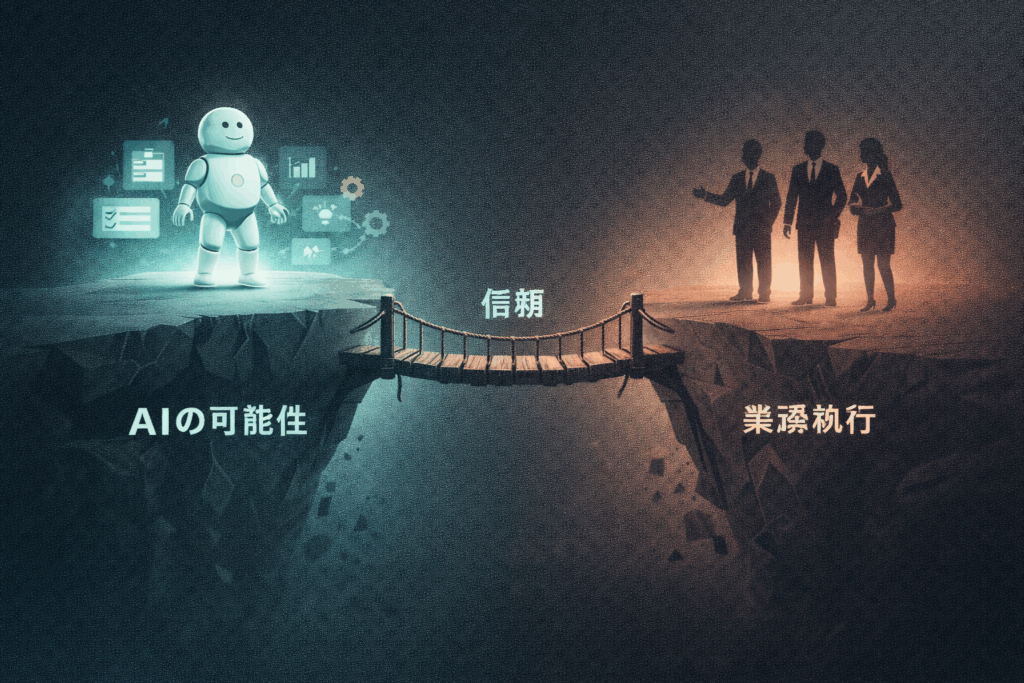

それが「信頼」です。

BCGのレポートは、この点を次のように表現しています。

AIにおける最大の課題は技術ではない。

人々がそれを信頼できるかどうかである。

エージェント型AIは、信頼されなければ「使われない」のではなく、「任せられない」。

この違いは、ITリーダーにとって決定的です。

なぜAIツール導入だけでは信頼は生まれないのか

BCGは、多くのAI施策が期待通りの成果を生まない理由を、次の事実として示しています。

- 多くの企業がAIツールを導入している

- しかし、実際に価値創出に成功しているのは約5%に過ぎない

このギャップの原因は、アルゴリズムやモデル性能ではありません。

- 誰がAIの判断に責任を持つのか

- どこまでAIに任せてよいのか

- 誤った判断が起きた場合、誰が、いつ、どのように介入するのか

こうした統治・責任・運用ルールが設計されないまま、ツール導入だけが先行していることが問題なのです。

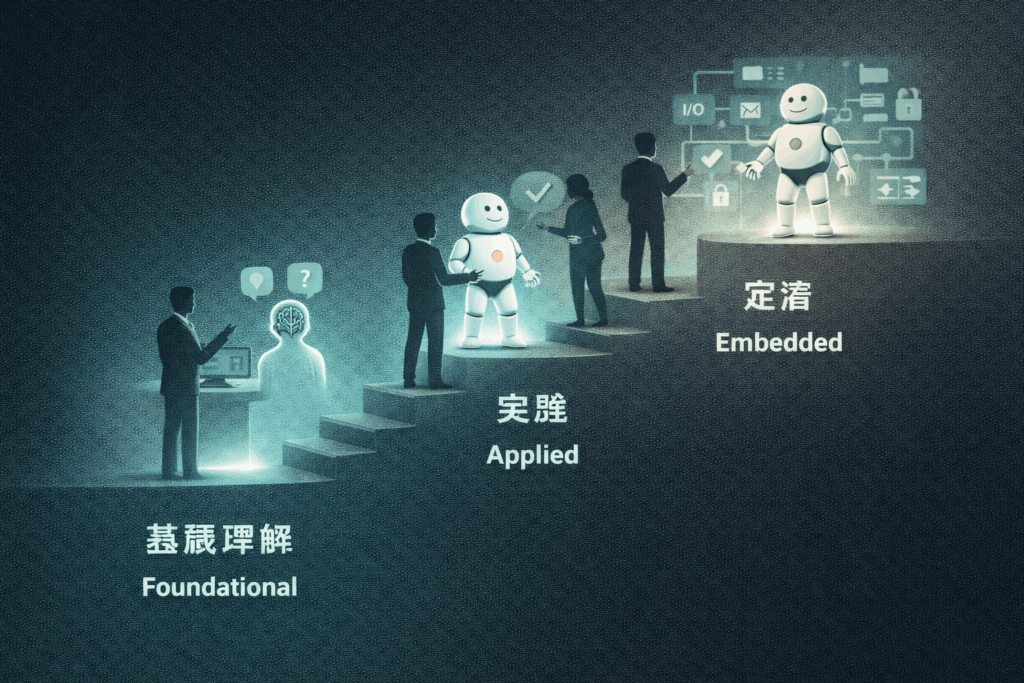

信頼は教育ではなく「行動の積み重ね」で形成される

BCGは、AI変革を単なる教育やスキル研修の課題として捉えていません。

重要なのは、人の行動が変わり、それが組織に定着することです。

レポートでは、AI能力の構築を次の3段階で整理しています。

- 基礎理解(Foundational)

AIの概念や可能性を理解する段階 - 実践(Applied)

実業務でAIを使い、試す段階 - 定着(Embedded)

業務プロセス、評価、役割に組み込まれる段階

BCGは明確に指摘しています。

- 行動変容が定着しなければ、AIはビジネス価値を生まない

特にエージェント型AIでは、次のような実体験が繰り返し積み重なることが不可欠です。

- AIに任せても業務が破綻しないという経験

- 例外時には人が確実に介入できるという安心感

- 判断と責任の所在が明確であるという共通理解

これらが日常業務の中で確認されることで、初めて信頼が形成されます。

リーダーが信頼を示さなければ、組織は任せない

信頼はボトムアップだけでは生まれません。

BCGは、AI変革におけるリーダーの役割を強く強調しています。

- 最も効果的なAI変革は、リーダーが先頭に立って行動することから始まる

エージェント型AIにおいて、リーダーが示すべきなのは推奨メッセージではありません。

- AIの判断を前提に意思決定する

- AIに任せた結果も含めて説明責任を果たす

- 成功も失敗も可視化する

BCGが紹介する企業では、経営層が次の共通認識を持った瞬間に変革が進みました。

- AI戦略は存在しない

- あるのは、AIに支えられた事業戦略だけである

この認識がなければ、現場はAIに仕事を任せる決断を下せません。

エージェント型AI時代のITリーダーに求められる責任

エージェント型AI時代のITリーダーは、単にAI技術やツールを評価する役割にとどまりません。

求められるのは、次のような責任です。

- 信頼の前提となる設計を行う

- AIに任せる範囲と人が介入するポイントを定義する

- 人とAIの役割分担を言語化する

- 行動変容が定着するまで組織に伴走する

つまり、「AIを動かす人」ではなく、「AIを信頼できる組織を設計する人」であることが求められます。

結論:エージェント型AIの成否は「信頼設計」で決まる

エージェント型AIは、現時点で最も高度で、最も人間的なAI活用形態です。

なぜならそれは、「どこまでAIを信じ、任せるか」という、組織としての意思決定そのものだからです。

技術は、すでに揃いつつあります。

残る最大の課題は、「信頼」をどのように設計し、組織に根付かせるかです。

そして、その役割を担うのが、今この瞬間のITリーダーです。