エージェント型AIの普及がもたらす新たなセキュリティ課題

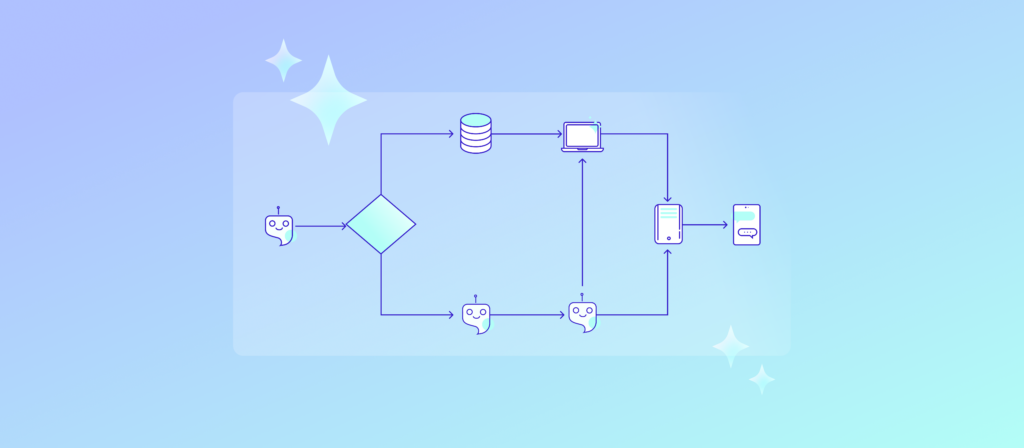

従来のソフトウェアとは異なり、AIエージェント(AI Agents)は自律的に行動します。自ら目標を設定し、意思決定を行い、APIやクラウドサービス、社内データと直接やり取りできるため、生産性と効率性を飛躍的に高める一方で、新たなセキュリティリスクも生まれています。

企業がエージェント型AI(Agentic AI)を導入する際には、リスクの理解・緩和策・ガバナンス体制の確立が不可欠です。これにより、機密データの保護、運用エラーの防止、AIへの信頼性維持が可能になります。

AIエージェントセキュリティとは

AIエージェントセキュリティとは、自律的に行動するAIエージェントの誤用・誤動作・攻撃を防ぐ仕組みです。AIエージェントは非決定的(nondeterministic)な性質を持ち、同じ入力でも状況や過去の対話、内部判断により異なる出力を返します。

この柔軟性こそがAIの強みである一方、予測不能な挙動を生む要因にもなります。

もし新入社員に、機密データへのアクセス権と外部システムへの操作権を与えたらどうでしょうか。適切な監視や権限管理がなければ、誤操作や情報漏えいのリスクが生じます。

AIエージェントも同様です。複数のシステムに対して「読み取り・書き込み・実行」を行うため、セキュリティとガバナンスは導入初期からの最重要課題です。

エージェント型AIにおける主要な脅威領域

AIエージェントのセキュリティ対策は、主に次の3つのリスクに焦点を当てます。

1. データセキュリティリスク

最も直接的なリスクはデータ漏えいです。エージェントが機密情報を扱う場合、不適切なアクセス制御があると、ユーザーからの指示に応じて意図せず情報を開示してしまうことがあります。

AIには「機密情報を守る」という概念がないため、システム側で明確な権限管理・認可制御・安全なデータ取得プロセス(Secure RAG)を構築する必要があります。

たとえば、社内財務データを要約するエージェントは、外部送信や共有を禁止する制御がない限り、誤って機密情報を送信する可能性があります。

企業は、最小特権アクセス(Least Privilege)を徹底し、「必要な情報のみアクセス・共有できる仕組み」を設けることが不可欠です。

2. 意図しない行動(Unintended Actions)

AIエージェントは非決定的であるため、同じ指示でも異なる結果を出す場合があります。

これは小さな操作ミスから、重大な業務障害まで発展するリスクを含みます。

例として:

- メール送信権限を持つエージェントが誤って別の宛先に機密情報を送信

- データ削除権限を持つエージェントが範囲を誤って大量のレコードを削除

- 財務レポートAIが承認なしに予測データを外部公開

こうしたリスクを防ぐためには、人間による監督(Human-in-the-Loop)と明確な安全ガードレールが必要です。エージェントの行動を管理者が逐次レビューすることで、誤操作を未然に防げます。

3. 外部からの攻撃・操作(Manipulation by Attackers)

AIエージェントは外部データを処理するため、攻撃者による操作(Adversarial Attacks)の影響を受けやすくなります。

たとえば:

- プロンプトインジェクションによる意図的な誘導

- データポイズニングによる学習情報の改ざん

- 外部APIの改ざんによる誤動作誘発

これらは、AIがアクセス可能なシステム範囲が広がるほど発生リスクも拡大します。

つまり、統合ポイント(API・クラウドサービス・外部コネクタ)すべてが潜在的な攻撃対象になるのです。

企業は、AIエージェントの多様な通信経路と動的な挙動に合わせて、セキュリティ戦略を再設計する必要があります。

AIエージェントを安全に運用するための基本戦略

エージェントセキュリティの鍵は、技術的制御・プロセスガバナンス・人的監督の3層構造にあります。

1. 権限管理(Authorization & Permissions)

エージェントは、ユーザーや利用目的に応じた適切な範囲の権限のみを持つべきです。高リスク操作(削除・送信・公開など)は、原則として人間の承認が必要です。

2. ツールアクセス制御(Tool Access Management)

各ツールやAPIに対し、次の質問を常に検討しましょう:

- エージェントは削除権限を持つ必要があるか?

- 外部通信を許可すべきか?

- 機密データベースへのアクセスは本当に必要か?

権限を最小化することで、誤動作や不正操作のリスクを大幅に減らせます。

3. ガードレールとHuman-in-the-Loop

重要または危険度の高い操作には必ず人間の承認プロセスを設けます。AIが提案したアクションをそのまま実行させるのではなく、「AIが提案 → 人間が承認 → 実行」という流れを確立することで、安全性を確保します。

4. モニタリングと説明可能性(Explainability)

従来のログ管理だけでは不十分です。AIエージェントの行動履歴を追跡し、「なぜその判断をしたのか」を説明できる仕組みが必要です。

複数のエージェントを同時に監視し、異常な行動を早期検知できる体制を構築しましょう。説明可能なAI(Explainable AI)は、セキュリティ分析や監査にも欠かせません。

エンタープライズAIセキュリティ導入の実践ステップ

- 権限範囲の定義

各エージェントがアクセスすべきシステム・データ・ツールを明確化します。不要なアクセス権の付与は避けることが鉄則です。 - アクセス制御の実装

IAM(Identity and Access Management)ツールを活用し、認証・認可をポリシーベースで一元管理します。 - 重要操作へのガードレール設定

財務更新や削除処理などの高リスクアクションは、自動実行ではなく人間承認を経て実行されるよう設計します。 - モニタリングと監査ログの整備

エージェントの行動ログを可視化し、異常を早期検出。監査証跡を保持することで、説明責任とガバナンスを確保します。 - 動的挙動への対応

エージェントは学習と共に進化します。

セキュリティポリシーも動的に更新できる柔軟な設計を取り入れましょう。

MCP(Model Context Protocol)が果たす役割

多くの企業は、AIエージェントと業務システムの安全な橋渡しとしてModel Context Protocol(MCP)を導入しています。

MCPは、エージェントとシステムの間に明確な構造化レイヤーを設け、各操作を「契約化」することで、エージェントが行える範囲を厳密に定義します。

- どのツールを使えるか

- どんな入力が必要か

- どんな出力を返すべきか

すべてをMCPが制御することで、自由度と安全性を両立できます。

つまり、オープンなAPI呼び出しではなく、監査可能な制御ステップとして処理が行われるのです。

これにより、権限逸脱や悪意あるプロンプトの影響を防ぎ、セキュリティチームが全ての操作を可視化・監督できるようになります。

▶︎ Workato Enterprise MCP完全ガイドはこちら

まとめ:エージェント型AIのセキュリティを今すぐ見直す

AIエージェントは、ビジネスの生産性を大きく高める一方で、従来のセキュリティモデルでは想定できなかった新たな課題をもたらします。

企業は、権限管理・モニタリング・ガバナンスを再構築し、自律的かつ分散的に動作するAIを安全に制御する必要があります。

WorkatoのEnterprise MCPは、AIエージェントのアクセス制御・ツール権限・セキュリティ運用を一元管理できる次世代のAIオーケストレーション基盤です。

安全性を犠牲にせず、AI導入の効果を最大化するなら、今こそセキュアなエージェント運用を始めましょう。

Workatoを活用することで、企業はAIエージェントを適切に設計・監視・ガバナンスしながら、

エージェント型AIがもたらす生産性と効率性の向上を最大限に享受できます。データ、業務オペレーション、ビジネスの健全性に対するリスクを最小限に抑えつつ、強力な新技術であるAgentic AIの可能性を安全に引き出せる、シンプルで実践的なアプローチです。

本記事は、Alex Doukas によって執筆されました。AlexはWeb開発を専門分野とし、フロントエンドからバックエンドまで、Web開発に関わる幅広い技術領域に精通しています。